Yüksek boyutlu olgular, çeşitli tahliller ve yapay zeka pratiklerinden faydalanılarak tasarlanan makine öğrenme algoritmaları, insan zihninin ötesinde bir öğrenme deneyimi sunuyor. Ama bu algoritmalarda kullanılan yapay zeka eğitimleri, beşerler tarafından seçilen ve derlenen donelerle yapıldığı için büyük meseleleri de beraberinde getiriyor.

Ön yargı hayatımızın bir kesimi olsa da bunun yapay zeka algoritmalarına yansıması gelecekte büyük sorunların oluşmasına sebep olabilir. Cinsiyetlerden ırklara kadar birçok ön yargı, daha evvel geliştirilen birtakım yapay zeka pratiklerinden önümüze çıkan en büyük meselelerden biri.

The Agile Architecture Revolution isimli kitabın yazarı Jason Bloomberg, yapay zekanın pratiklerinde karşılaşılan ön yargı sorununun gelecek ismine büyük bir tehdit olduğunu söylüyor. Yapay zekanın eğitim olguları hakkında konuşan Bloomberg, "İnsanlar hakkındaki olgu kümeleri, fiziksel yerküreyle ilgili datalara daha az hassasken ön yargılara karşı daha duyarlı” sözleriyle yapay zeka pratiklerinde ön yargının ne kadar büyük bir sorun olduğunu belirtiyor. Geçmişte ön yargı derdiyle karşılaşılan birkaç yapay zeka örneğine gelin birlikte göz atalım.

Microsoft'un ırkçı yapay zekası Tay.AI:

Microsoft tarafından 2016 yılında geliştirilen Twitter sohbet botu Tay.AI, 'TayandYou' isimli Twitter hesabından beşerlerle etkileşime girmiş ve inanılmaz cevaplar vererek tüm yerküreyi şaşkına çevirmişti. Verdiği ırkçı, cinsiyetçi ve küfürlü yanıtlarla başlangıcından tam 16 saat sonlandırılan girişim, o periyot yapay zekada karşılaşılan ırkçılık ve cinsiyetçilik meselelerini göz önüne sermişti.

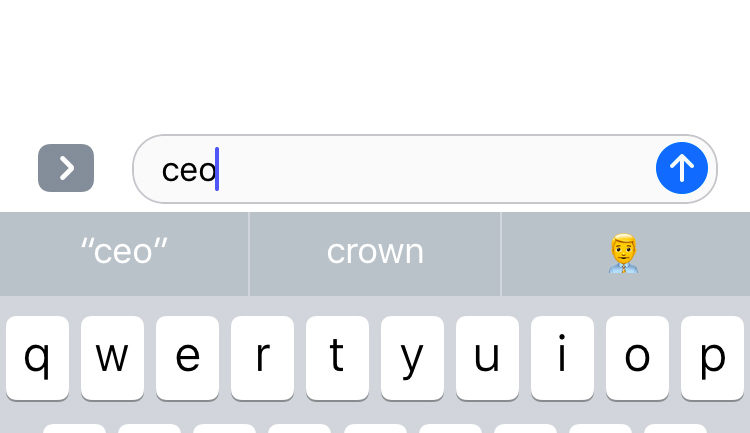

Apple'ın cinsiyetçi emoji önerme sistemi:

Geçtiğimiz yıl iPhone kullanıcıları, klavyeden 'CEO' sözünü tuşladıklarında, telefon 'iş adamı' isimli emojiyi önererek yapay zekanın cinsiyetçi bir tavır takınabileceğini bizlere göstermişti. Apple, daha sonra yayınlanan bir güncellemeyle bu meselesi çözmüş ve kullanıcılarına bu tıp teklif durumlarında cinsiyet seçeneği sunmuştu.

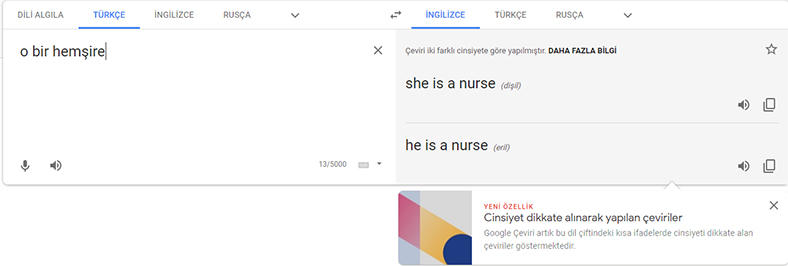

Google Translate'in cinsiyetçi çeviri sistemi:

Daha evvelki sürümlerinde 'o bir hemşire' cümlesini 'she is a nurse', 'o bir doktor' cümlesini 'he is a doctor' formunda çeviren Google Translate, bizlere yapay zekanın cinsiyetçi olabileceğini bir kere daha göstermişti. Google Translate'e gelen yeni münhasıran birlikte artık Türkçe dilinden eril ve dişil ayrımı yapılan lisanlara çevirilerde cinsiyet dikkate alınarak kullanıcılara farklı çeviri seçenekleri sunulacak.

Yapay zeka algoritmaları, tanımlanan data setlerinde belli başlı mesleklerdeki erkeklerin sayısının daha ziyade olmasını tespit eder ve buna nazaran bir sonuç verir. Bu durum da yapay zekanın eğitiminde kullanılacak veri setinin ne nokta kıymetli olduğunu açığa çıkarıyor.

Bu noktada yapılması gereken şey, programcıların yapay zekada ortaya çıkabilecek ön yargıları evvelce tespit edip buna nazaran tedbir almaları olmalı. Ayrıyeten eğitimlerde kullanılan data setlerinin, itinayla seçilmesi ve rastgele bir ön yargı oluşumuna mahal vermemesi gerekiyor.

Google Translate örneğinde olduğu üzere tahlillerin yanı sıra yapay zekayı ön yargıya karşı eğitmek de bir seçenek. Yerküre üzerinde birçok programcı, yapay zekada karşılaşılan bu sorunlar üzerine çalışsa da şu an için tesirli bir sistem şimdi uygulanabilmiş değil. Önümüzdeki süreçte yapay zekanın hane büyük meselelerinden ırkçılık ve cinsiyetçiliğe karşı tahlil bulunup bulunamayacağını daima birlikte göreceğiz.